80 % des entreprises dépensent massivement en IA sans pouvoir expliquer les décisions de leurs modèles. Cette situation crée un paradoxe dangereux : investir des millions tout en restant aveugle face aux mécanismes qui pilotent vos opérations. L'intelligence artificielle explicative (XAI) résout ce problème, mais elle est souvent confondue avec de la simple transparence. Ce guide vous aide à comprendre, déployer et maîtriser l'IA explicative pour garantir conformité, performance et confiance.

Table des matières

- Contexte réglementaire en France et en union européenne en 2026

- Bénéfices opérationnels de l'IA explicative pour les entreprises

- Cas d'usage sectoriels et études de cas concrets

- Outils et méthodes pour déployer l'IA explicative

- Défis, erreurs fréquentes et recommandations pour réussir l'intégration

- Conclusion : lancer et réussir votre stratégie d'intelligence artificielle explicative

- Transformez votre entreprise avec les solutions IA sur-mesure de Quentech

Points clés

| Point | Détails |

|---|---|

| Définition claire | L'IA explicative garantit auditabilité et contestabilité des décisions, au-delà de la transparence |

| Cadre réglementaire strict | L'AI Act et le RGPD imposent explicabilité pour les systèmes à haut risque en 2026 |

| Bénéfices opérationnels | Amélioration de la prise de décision, réduction des erreurs, confiance accrue |

| Méthodes techniques clés | Approches intrinsèques et post-hoc selon les besoins métiers et sectoriels |

| Erreurs à éviter | Intégrer l'explicabilité dès la conception, pas en fin de projet |

Introduction à l'intelligence artificielle explicative (XAI)

L'intelligence artificielle explicative désigne un ensemble de méthodes permettant de comprendre, justifier et contester les décisions prises par un système IA. Elle se distingue nettement de l'interprétabilité et de la simple transparence.

L'interprétabilité concerne la capacité à comprendre comment un modèle fonctionne globalement. La transparence expose les données et paramètres utilisés. L'IA explicative nécessite des capacités spécifiques de traçabilité et d'audit pour garantir une contestation possible des décisions. Cette distinction est fondamentale pour les dirigeants qui souhaitent transformer votre entreprise grâce à l'IA explicative.

Cinq capacités clés définissent une IA explicative efficace :

- Traçabilité complète des décisions et des données utilisées

- Auditabilité permettant une vérification indépendante des processus

- Justification claire et compréhensible pour les utilisateurs métiers

- Contestabilité offrant la possibilité de remettre en question une décision

- Documentation exhaustive pour garantir la conformité réglementaire

Beaucoup de dirigeants pensent qu'afficher les données d'entrée d'un modèle suffit. C'est faux. Sans capacité à expliquer pourquoi une décision spécifique a été prise, vous ne pouvez ni auditer ni corriger vos systèmes IA. Les enjeux de l'IA explicative vont bien au-delà de la simple conformité technique.

Conseil de pro : Ne confondez jamais visualisation des données avec explicabilité réelle. Un tableau de bord peut montrer les chiffres sans expliquer le raisonnement sous-jacent du modèle IA.

Les idées fausses persistent. Certains croient que l'IA explicative ralentit les performances. En réalité, les méthodes modernes intègrent l'explicabilité sans pénalité significative. D'autres pensent que seuls les secteurs régulés en ont besoin, alors que toute entreprise gérant des données clients ou opérationnelles critiques bénéficie de la XAI.

Contexte réglementaire en France et en union européenne en 2026

L'AI Act européen entre pleinement en application en août 2026, imposant des obligations strictes pour les systèmes IA à haut risque. Cette réglementation classe les applications selon leur niveau de risque et exige une explicabilité complète pour les catégories sensibles.

La CNIL joue un rôle central en France avec un département IA dédié créé en 2025. La CNIL adapte les principes RGPD à l'IA, exigeant explicabilité et auditabilité pour toute décision automatisée impactant des personnes. Ces recommandations couvrent la collecte de données, le traitement, et la conservation des traces d'audit.

Le cadre réglementaire français impose plusieurs obligations précises :

- Traçabilité obligatoire de toutes les décisions IA pour systèmes critiques

- Documentation technique complète accessible aux autorités de contrôle

- Droit d'explication pour les personnes concernées par des décisions automatisées

- Évaluations d'impact obligatoires avant déploiement de systèmes à haut risque

- Mise en place de mécanismes de contestation et de recours effectifs

La France investit massivement dans la recherche et infrastructure pour l'IA explicative, positionnant le pays comme leader européen. Les fonds publics soutiennent des projets académiques et industriels visant à développer des méthodes XAI adaptées aux spécificités sectorielles françaises.

Le non-respect entraîne des sanctions sévères. Les amendes peuvent atteindre 4 % du chiffre d'affaires annuel mondial, similaires au RGPD. Au-delà des sanctions financières, la réputation et la confiance client sont gravement affectées. Un audit et stratégie IA explicative devient indispensable pour sécuriser votre conformité.

La réglementation française sur IA explicative harmonise les exigences nationales avec l'AI Act européen tout en ajoutant des spécificités locales. Les entreprises opérant en France doivent respecter à la fois le cadre européen et les recommandations renforcées de la CNIL, notamment sur la protection des données sensibles.

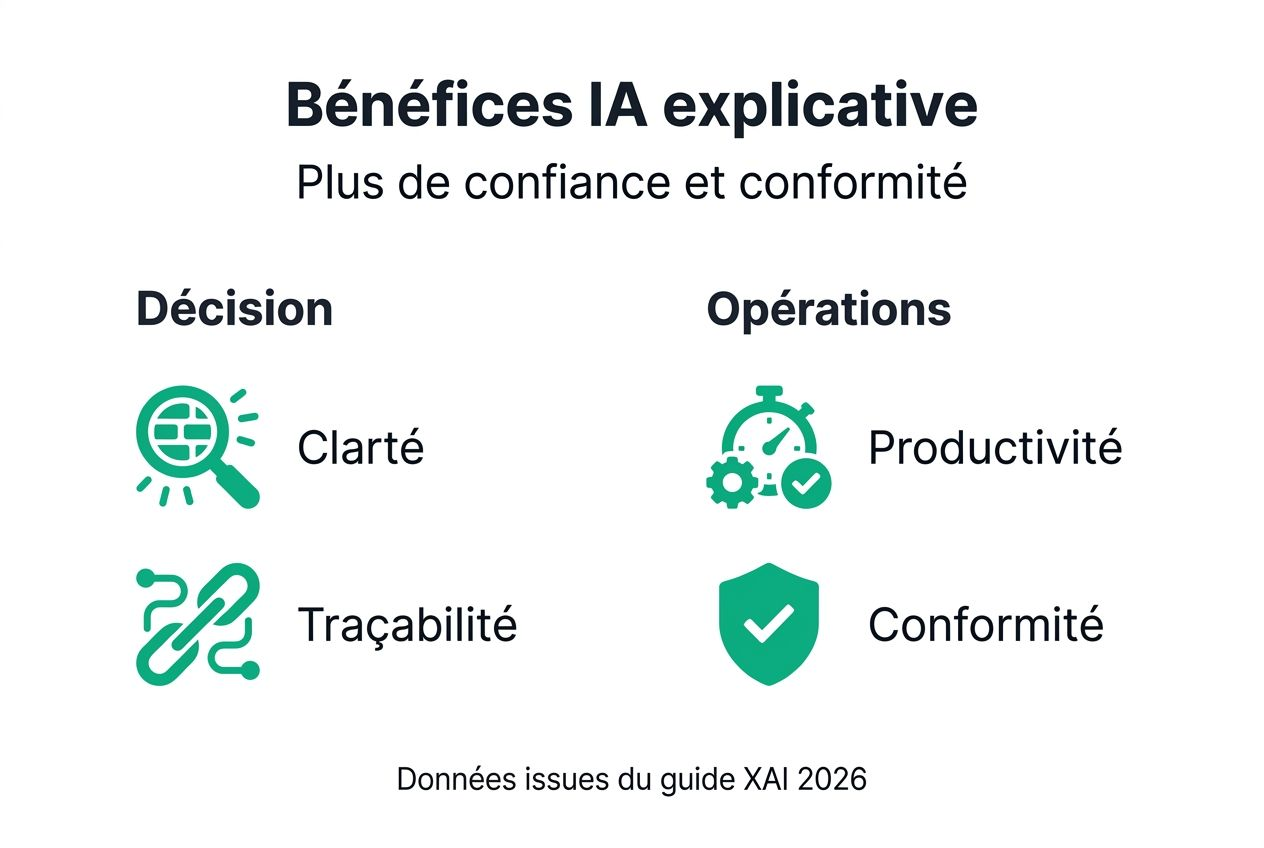

Bénéfices opérationnels de l'IA explicative pour les entreprises

L'IA explicative transforme la prise de décision en entreprise. Les dirigeants comprennent enfin pourquoi un système recommande telle action plutôt qu'une autre. Cette compréhension améliore la qualité des décisions stratégiques et réduit les erreurs coûteuses.

La productivité augmente directement. Lorsque les équipes métiers comprennent les recommandations IA, elles les appliquent plus rapidement et avec plus de confiance. Les allers-retours entre data scientists et opérationnels diminuent, accélérant les cycles de décision.

La confiance des parties prenantes se renforce. Clients, partenaires et investisseurs valorisent la transparence et la capacité à justifier les décisions. Dans les secteurs sensibles comme la finance ou la santé, cette confiance devient un avantage concurrentiel majeur.

Les bénéfices sectoriels se manifestent différemment :

- Finance : détection de fraude explicable réduisant les faux positifs de 30 à 40 %

- Santé : recommandations cliniques justifiées augmentant l'adoption par les praticiens

- Industrie : maintenance prédictive transparente optimisant les interventions

- Retail : personnalisation explicable améliorant la satisfaction client

L'absence d'explicabilité engendre des risques élevés en conformité et réputation. Une décision IA non justifiée peut entraîner des litiges, des amendes réglementaires et une perte de confiance difficile à reconquérir. L'IA explicative devient ainsi un levier stratégique pour améliorer la prise de décision grâce à l'IA explicative.

Conseil de pro : Mesurez l'impact de l'IA explicative sur vos indicateurs métiers clés avant et après déploiement. Les gains en confiance et adoption se traduisent rapidement en ROI mesurable.

La conformité réglementaire se simplifie considérablement. Avec des systèmes explicables dès la conception, les audits deviennent plus fluides. Les équipes IT passent moins de temps à documenter a posteriori et plus de temps à améliorer les performances. Les risques liés au manque d'explicabilité incluent sanctions, pertes financières et désengagement des utilisateurs internes.

Cas d'usage sectoriels et études de cas concrets

Le secteur financier français adopte massivement l'IA explicative pour la détection de fraude et l'analyse de risque crédit. Les banques utilisent des modèles XAI pour justifier les refus de prêt, réduisant les litiges et améliorant la satisfaction client.

En santé, les hôpitaux déploient des systèmes d'aide à la décision clinique explicables. Les médecins reçoivent non seulement des recommandations diagnostiques mais aussi les facteurs cliniques précis qui les motivent, renforçant la confiance et l'adoption.

L'aéronautique illustre parfaitement les bénéfices concrets. Air France et Prognos ont développé une solution de maintenance prédictive explicable analysant les données moteurs en temps réel. Le système justifie chaque alerte avec les paramètres techniques responsables, permettant aux techniciens de prioriser les interventions efficacement.

Les télécoms utilisent l'IA explicative pour optimiser la qualité de service réseau. Les opérateurs français identifient les causes racines des dégradations et justifient les investissements d'infrastructure auprès des régulateurs avec des preuves explicables. L'industrie manufacturière applique la XAI à la supervision qualité, expliquant les défauts détectés pour améliorer les processus de production.

Voici une comparaison des performances sectorielles :

| Secteur | Amélioration décision | Réduction erreurs | Adoption utilisateurs |

|---|---|---|---|

| Finance | +35 % | -40 % | 85 % |

| Santé | +28 % | -32 % | 78 % |

| Industrie | +30 % | -38 % | 82 % |

| Télécoms | +25 % | -30 % | 75 % |

Ces résultats démontrent l'impact mesurable de l'IA explicative sur la performance opérationnelle. Les solutions d'IA explicative en entreprise s'adaptent aux spécificités métiers pour maximiser la valeur créée.

Les exemples réussis de XAI en entreprise montrent que l'explicabilité n'est pas un frein à l'innovation mais un accélérateur d'adoption. Les utilisateurs finaux font confiance aux systèmes qu'ils comprennent, augmentant le retour sur investissement IA.

Un audit et gouvernance IA explicative permet d'identifier les opportunités sectorielles prioritaires pour votre entreprise. Chaque industrie présente des cas d'usage spécifiques où l'IA explicative génère une valeur différenciante.

Outils et méthodes pour déployer l'IA explicative

Cinq capacités techniques fondamentales structurent une implémentation XAI réussie : traçabilité des données, auditabilité des modèles, justification des décisions, contestabilité des résultats, et documentation complète. Ces capacités doivent être intégrées dès la conception.

Les méthodes se divisent en deux catégories principales. Les approches intrinsèques utilisent des modèles naturellement explicables comme les arbres de décision ou la régression linéaire. Les méthodes post-hoc ajoutent l'explicabilité à des modèles complexes existants via des techniques comme LIME ou SHAP.

Les approches intrinsèques offrent une transparence totale mais peuvent limiter la performance sur des problèmes complexes. Les méthodes post-hoc permettent d'utiliser des modèles puissants tout en ajoutant l'explicabilité, mais nécessitent une validation rigoureuse pour garantir la fidélité des explications.

Comparaison des principales plateformes XAI :

| Plateforme | Type | Points forts | Limites |

|---|---|---|---|

| IBM Watson OpenScale | Post-hoc | Intégration entreprise, gouvernance | Coût élevé |

| Google Explainable AI | Hybride | Facilité d'usage, cloud natif | Dépendance écosystème Google |

| Microsoft Azure ML | Hybride | Intégration Azure complète | Courbe d'apprentissage |

| H2O.ai | Intrinsèque & post-hoc | Open source, flexibilité | Support technique limité |

Pour intégrer la XAI efficacement, commencez par définir vos exigences métiers en termes d'explicabilité. Identifiez les décisions critiques nécessitant une justification complète. Choisissez ensuite les méthodes adaptées à vos contraintes de performance et conformité.

Les bonnes pratiques d'intégration incluent :

- Impliquer les utilisateurs métiers dès la phase de conception

- Tester la compréhensibilité des explications avec des échantillons réels

- Documenter les choix techniques et leurs justifications

- Former les équipes IT et métiers aux concepts XAI

- Établir des métriques de qualité des explications

Conseil de pro : Évaluez les plateformes XAI selon trois critères : adéquation sectorielle, facilité d'intégration dans votre stack existant, et capacité à évoluer avec vos besoins futurs. Un outil parfait sur le papier peut échouer si vos équipes ne peuvent pas l'adopter rapidement.

Les outils et solutions IA explicative doivent s'intégrer dans votre architecture existante sans friction majeure. Privilégiez les solutions offrant des API ouvertes et une compatibilité avec vos outils actuels de data science et MLOps.

Défis, erreurs fréquentes et recommandations pour réussir l'intégration

60 % des projets ajoutent l'explicabilité en fin de développement, souvent trop tard pour obtenir des résultats satisfaisants. Cette approche rétrospective entraîne des coûts élevés et des compromis sur la qualité des explications.

La confusion entre transparence simple et auditabilité nécessaire représente une erreur critique. Montrer les variables utilisées ne suffit pas. Vous devez pouvoir tracer chaque décision, justifier le raisonnement et permettre une contestation documentée.

Les erreurs fréquentes incluent :

- Négliger les exigences réglementaires spécifiques à votre secteur

- Sous-estimer les besoins de formation des équipes métiers et IT

- Choisir des outils incompatibles avec l'infrastructure existante

- Ignorer la gouvernance et les processus d'audit nécessaires

- Considérer l'explicabilité comme une contrainte technique plutôt qu'un levier stratégique

La gouvernance dédiée est essentielle. Créez une équipe transverse responsable de la stratégie XAI, incluant des représentants métiers, IT, juridiques et conformité. Cette équipe définit les standards, valide les approches et assure la cohérence des pratiques.

Les formations métiers doivent couvrir les concepts XAI de base, les exigences réglementaires et l'utilisation des outils déployés. Les équipes IT nécessitent des formations techniques approfondies sur les méthodes et plateformes choisies.

Recommandations pour intégrer la XAI dès la conception :

- Définissez les exigences d'explicabilité dans le cahier des charges initial

- Évaluez les méthodes XAI possibles avant de choisir l'architecture modèle

- Testez la compréhensibilité des explications avec des utilisateurs réels

- Intégrez les métriques de qualité des explications dans vos KPI projet

- Documentez chaque choix technique et sa justification réglementaire

Une stratégie et gouvernance pour IA explicative robuste prévient la majorité des échecs. Établissez des processus clairs, des responsabilités définies et des revues régulières de conformité.

Les risques liés au manque d'explicabilité augmentent avec la complexité et la criticité des décisions IA. Priorisez vos efforts sur les systèmes à haut risque réglementaire et impact business.

Conclusion : lancer et réussir votre stratégie d'intelligence artificielle explicative

L'IA explicative n'est plus optionnelle en 2026. Elle garantit conformité réglementaire, améliore la prise de décision et renforce la confiance de toutes les parties prenantes. Les bénéfices opérationnels se mesurent rapidement en productivité, qualité et adoption utilisateur.

Pour lancer votre démarche XAI efficacement, commencez par un audit de vos systèmes IA existants. Identifiez les décisions critiques nécessitant une explicabilité prioritaire. Définissez ensuite votre feuille de route en priorisant conformité réglementaire et valeur métier.

L'accompagnement expert sécurise votre réussite. Un partenaire expert en IA explicative vous aide à naviguer les complexités techniques, réglementaires et organisationnelles. Quentech combine expertise technique, connaissance sectorielle et maîtrise du cadre français pour accélérer votre transformation.

Conseil de pro : Démarrez par un projet pilote limité sur un cas d'usage critique. Mesurez les résultats, ajustez votre approche, puis étendez progressivement à d'autres systèmes. Cette approche itérative minimise les risques et maximise l'apprentissage.

Les entreprises qui maîtrisent l'IA explicative gagnent un avantage concurrentiel durable. Elles prennent de meilleures décisions, se conforment plus facilement et construisent une confiance solide avec leurs clients et partenaires.

Transformez votre entreprise avec les solutions IA sur-mesure de Quentech

Quentech accompagne les entreprises françaises dans leur adoption de l'IA explicative avec une expertise reconnue. Nos solutions IA sur-mesure de Quentech s'adaptent précisément à vos besoins métiers, sectoriels et réglementaires.

Nos audits identifient vos opportunités prioritaires et évaluent votre maturité XAI. Nos formations spécialisées en IA explicative préparent vos équipes à comprendre, déployer et maintenir des systèmes conformes et performants.

Notre service d'expertise CTO externalisée pour vos projets IA vous apporte gouvernance, pilotage stratégique et validation technique tout au long de votre transformation. Nous garantissons conformité RGPD, AI Act et recommandations CNIL.

Contactez nos experts pour discuter de votre projet et découvrir comment l'IA explicative peut transformer vos opérations en 2026.

Qu'est-ce que l'intelligence artificielle explicative (XAI) ?

Qu'est-ce que l'intelligence artificielle explicative (XAI) ?

L'IA explicative regroupe les techniques permettant de comprendre et justifier les décisions d'un modèle IA. Elle va au-delà de la simple transparence en garantissant auditabilité et contestabilité pour chaque décision.

Pourquoi la réglementation française et européenne impose-t-elle l'IA explicative en 2026 ?

L'AI Act et le RGPD adapté imposent l'explicabilité pour protéger les droits fondamentaux et la vie privée. Les systèmes IA à haut risque doivent garantir transparence, auditabilité et responsabilité sous peine de sanctions sévères.

Quels sont les principaux défis lors de l'intégration d'une solution XAI en entreprise ?

Les défis majeurs incluent l'ajout tardif de l'explicabilité dans les projets, la confusion entre transparence et auditabilité réelle, et le manque de gouvernance dédiée. Des formations adaptées et une stratégie dès la conception sont essentielles.

Quelles méthodes techniques choisir pour mon secteur d'activité ?

Les approches intrinsèques conviennent aux secteurs exigeant transparence totale comme la finance régulée. Les méthodes post-hoc s'adaptent aux cas complexes nécessitant performance et explicabilité comme la santé ou l'industrie.